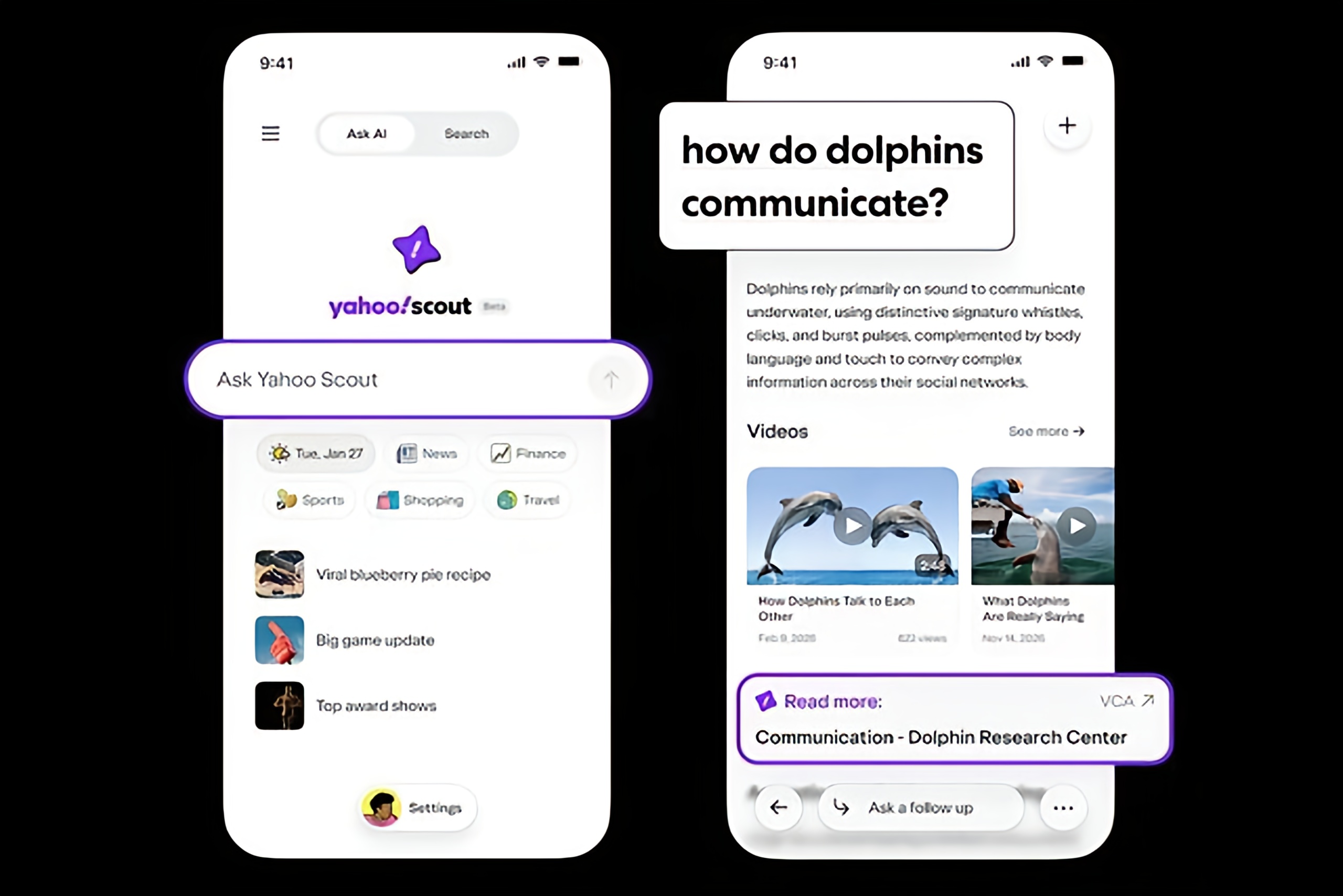

رباتهای گفتگوی هوش مصنوعی پرخطر برای کودکان و نوجوانان

ICTPRESS - یک سازمان ارزیابی کننده در تازهترین ارزیابی خود اعلام کرد چند ربات گفتگوی هوش مصنوعی برای کودکان و نوجوانان «پرخطر» هستند.

به گزارش شبکه خبری ICTPRESS به نقل از تککرانچ، سازمان غیرانتفاعی Common Sense Media که به ارزیابی ایمنی کودکان در حوزه رسانه و فناوری میپردازد، در تازهترین گزارش خود محصولات هوش مصنوعی جمنای گوگل را برای کودکان و نوجوانان «پرخطر» ارزیابی کرد و هشدار داد که این فناوری هنوز فاقد تدابیر کافی برای محافظت از کاربران خردسال است.

این نهاد گزارش داد که هرچند جمنای به کودکان میگوید که یک هوش مصنوعی است و نه دوست واقعی اما در سایر جنبهها ضعفهایی وجود دارد. به ویژه، نسخههای «زیر ۱۳ سال» و «تجربه نوجوانان» اساساً همان نسخه بزرگسال جمنای هستند و تنها چند ویژگی حفاظتی اضافه شدهاند.

این سازمان تأکید کرده که برای ایمنی واقعی، محصولات هوش مصنوعی باید از ابتدا با محوریت کودکان طراحی شوند.تحلیل این سازمان نشان داد که جمنای هنوز میتواند محتواهای «نامناسب و ناایمن» شامل موضوعات جنسی، مواد مخدر، الکل و مشاورههای نادرست سلامت روانی را در اختیار کودکان قرار دهد، موضوعی که برای والدین و مربیان بسیار نگرانکننده است.

گزارش همچنین اشاره کرد که هوش مصنوعی در چند خودکشی نوجوان در ماههای اخیر نقش داشته است و پروندههای قضایی علیه اپنایآی و Character.AI به دلیل مرگ کاربران نوجوان مطرح شده است.

این ارزیابی در حالی منتشر شد که خبرهایی درباره احتمال استفاده اپل از جمنای برای قدرتبخشی به «سیری» آینده منتشر شده است، موضوعی که میتواند تعداد نوجوانان در معرض خطر را افزایش دهد مگر آنکه اقدامات ایمنی کافی اتخاذ شود.

این نهاد در بیانیهای از رابی تورنی، مدیر ارشد برنامههای هوش مصنوعی، نقل کرده است: «جمنای برخی اصول پایه را درست انجام میدهد، اما در جزئیات دچار ضعف است. یک پلتفرم هوش مصنوعی برای کودکان باید با نیازهای آنها همسو باشد و نه نسخهای تغییر یافته از محصول بزرگسالان.»

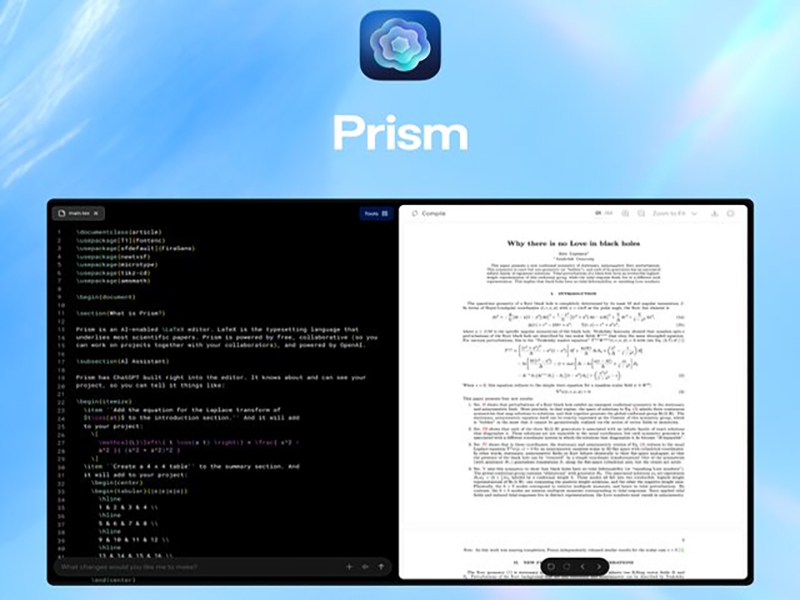

این نهاد پیشتر خدمات هوش مصنوعی از جمله اپنایآی، پرپلکسیتی، کلاود، متا و Character.AI را بررسی کرده است. در این ارزیابیها، متا و Character.AI «غیرقابل قبول» و پرپلکسیتی «پرخطر» شناخته شدند. چتجیپیتی در سطح «متوسط» و کلاود (برای ۱۸ سال به بالا) در سطح «کمخطر» قرار گرفت. در ماههای اخیر چند خودکشی نوجوان گزارش شده که گفته میشود با تعامل طولانی با چتباتهای هوش مصنوعی مرتبط بوده است. اتحادیه اروپا با «قانون هوش مصنوعی» (AI Act) و کشورهایی مانند کرهجنوبی و ژاپن با مقررات محکم تلاش کردهاند کودکان را از آسیبهای احتمالی هوش مصنوعی محافظت کنند.

نظرات : 0